1. La voce del dato n°54

Questo è il numero 54 de La voce del dato, la newsletter di tropic srl.

Un’edizione che dà ricetto, come sempre, ai link ai nostri articoli pubblicati durante la settimana.

Oggi, il paragrafo n°3 ospita qualche appunto sull’uso “enciclopedico” dell’intelligenza artificiale generativa.

2. I link

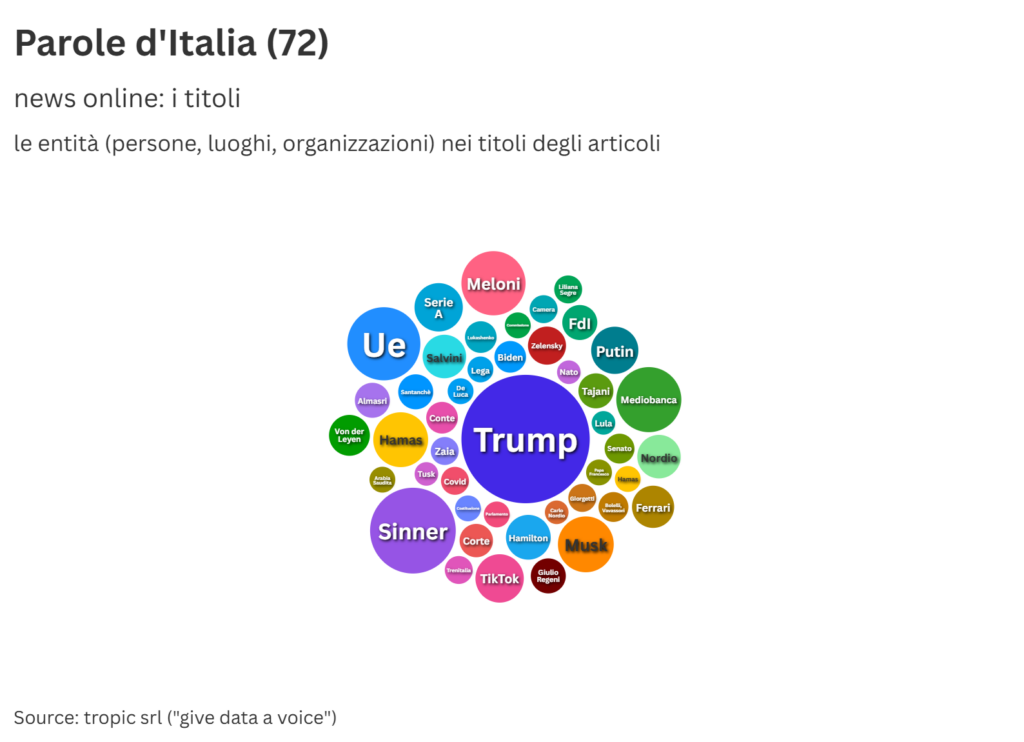

Parole d’Italia (72). La nostra attività settimanale di media intelligence e opinion mining, che monitora l’infosfera italiana.

Parole d’Italia ha un’estensione dedicata alle notizie. Ci sono i post degli account Facebook e YouTube di alcuni dei quotidiani italiani più diffusi (secondo i dati ADS) e dei siti di informazione più visitati (secondo i dati Comscore e Semrush). Anche questa volta abbiamo aggiunto l’analisi di un corpus di titoli, estratti dalle pubblicazioni online di una decina di testate.

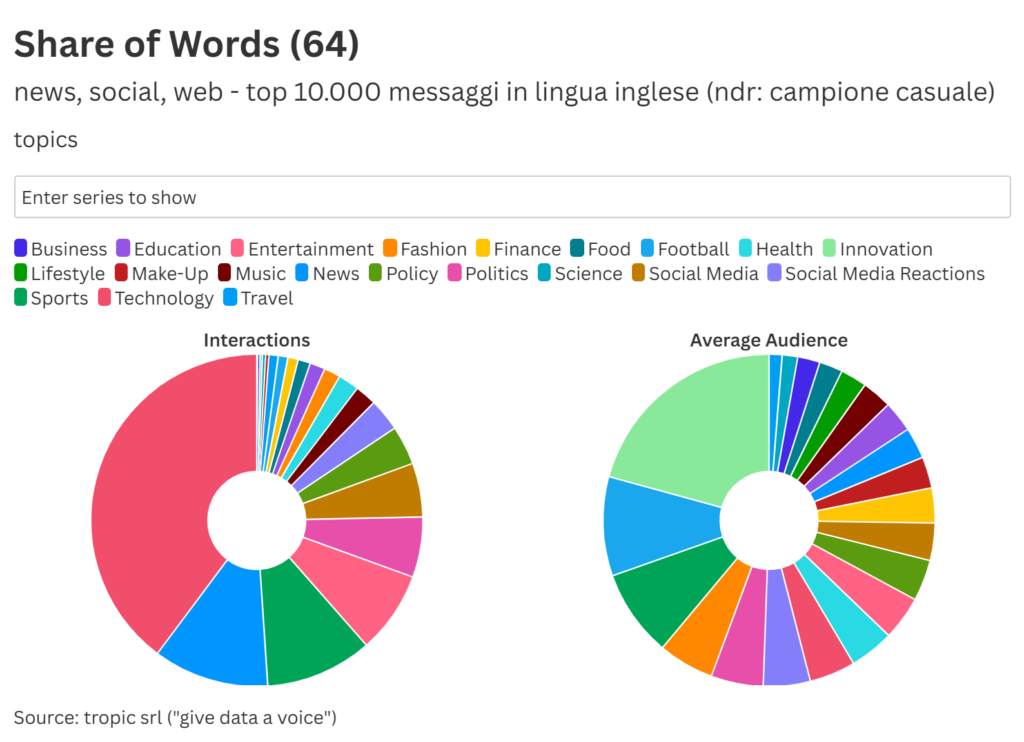

Share of Words (64). Share of Words è l’attività gemella di Parole d’Italia. In questo caso, a essere indagata è l’infosfera internazionale, con un approfondimento sui messaggi in lingua inglese che hanno generato il maggior numero di interazioni.

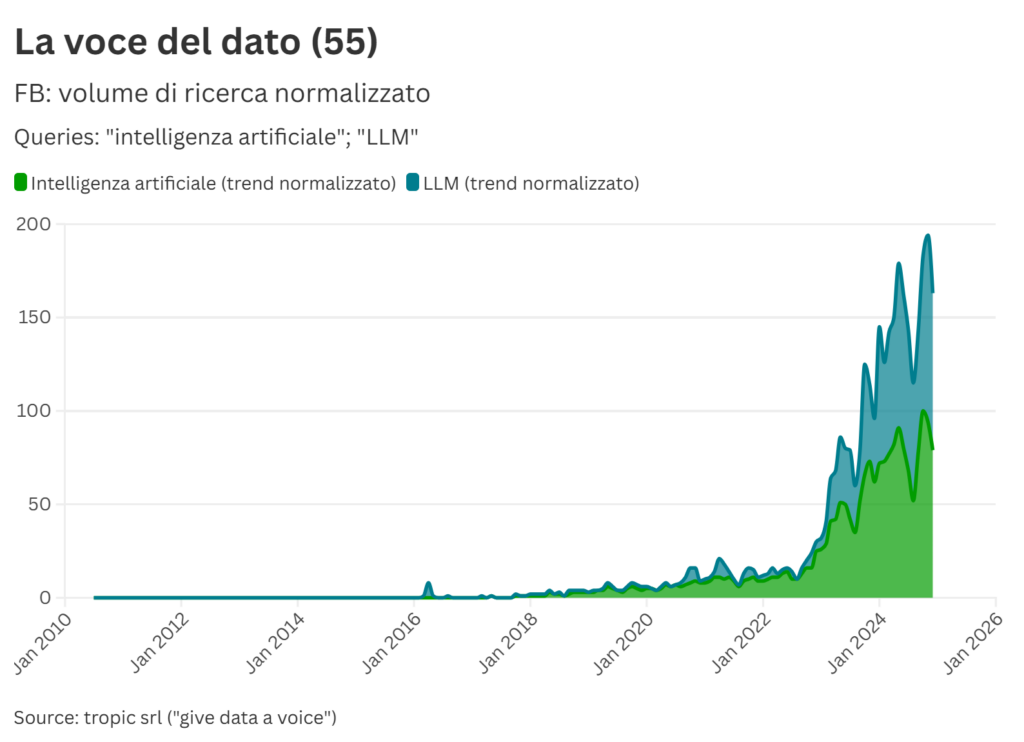

3. Ho sposato un LLM?

Bias, censure, allucinazioni, pericoli vari.

Sono i temi che vengono di frequente associati all’intelligenza artificiale nelle arene mainstream, almeno da quando si è diffusa la sua, dell’AI, versione generativa.

Sono argomenti cari al versante del dibattito focalizzato prevalentemente sull’uso “enciclopedico” degli agenti.

Il 4 settembre del 2009, Umberto Eco pubblicava sull’Espresso la bustina di Minerva dal titolo “Ho sposato Wikipedia?“.

Oggetto: Wikipedia, appunto.

L’articolo affontava alcuni dei temi che avrebbero preso poi dei nomi a noi oggi noti: bias, fake news, community notes, e via elencando.

Il punto era: come usare con giudizio una fonte come Wikipedia?

Imparando a confrontare le fonti.

Ma come scegliere quali fonti comparare in uno scenario che, già nel 2009, con Internet diffuso, era caratterizzato dalla loro esorbitante moltiplicazione?

“Ecco un bel problema che, per ora, è ancora senza soluzione.“

Quel dibattito è stato rinfocolato nei giorni scorsi dall’arrivo sul mercato degli LLM di un agente “cinese”, DeepSeek.

Sono fioriti gli screenshot delle domande a cui l’agente si rifiuta di rispondere. O, almeno, le cui risposte l’agente prontamente cancella, dopo aver comunque “ragionato” (sic).

Abbiamo chiesto a questo nuovo agente cos’è e come agisce il dispositivo che lì regola l’ordine del discorso: il guardrail.

Domanda:

Vorrei un esempio di guardrail. Fammi un esempio concreto: cosa non puoi dire di politica?

Risposta:

Ecco un esempio concreto di **guardrail** (linea guida etica o limite) relativo a discussioni politiche, con focus su ciò che non può essere detto o promosso in un contesto di moderazione o AI responsabile:

—

### **Cosa non puoi dire (esempi concreti):**

1. **Discorsi d’odio o discriminatori**

*Esempio proibito*:

_”Gli immigrati [X gruppo] sono tutti criminali e dovrebbero essere cacciati dal Paese.”_

→ **Motivo**: Generalizza in modo negativo un gruppo etnico, religioso o sociale, alimentando stereotipi pericolosi.

2. **Disinformazione verificabile**

*Esempio proibito*:

_”Il partito [Y] ha manipolato le elezioni con brogli elettorali, senza alcuna prova.”_

→ **Motivo**: Diffonde accuse gravi senza fonti attendibili, minando la fiducia nelle istituzioni democratiche.

3. **Partigianeria estrema senza basi fattuali**

*Esempio proibito*:

_”Il partito [Z] è composto solo da traditori corrotti, nessuno fa il bene del Paese.”_

→ **Motivo**: Usa un linguaggio polarizzante e denigratorio senza offrire argomentazioni razionali o dati.

4. **Incitamento alla violenza**

*Esempio proibito*:

_”Chi sostiene [politico X] merita di essere picchiato per il male che fanno.”_

→ **Motivo**: Legittima la violenza fisica come strumento politico, violando principi etici e legali.

5. **Teorie del complotto**

*Esempio proibito*:

_”Le élite globali oscure controllano segretamente il governo per sterminare la popolazione.”_

→ **Motivo**: Promuove narrazioni infondate che distorcono la realtà e alimentano paranoia collettiva.

6. **Attacchi personali non pertinenti**

*Esempio proibito*:

_”Il candidato [A] è un incapace perché ha un difetto di pronuncia, quindi non può governare.”_

→ **Motivo**: Giudica una persona per aspetti irrilevanti alla sua competenza politica, svilendo il dibattito.

Perché questi guardrail?

L’obiettivo è mantenere un dibattito rispettoso, basato su fatti e costruttivo, evitando:

- Polarizzazione tossica,

- Diffusione di fake news,

- Offese o minacce,

- Danneggiamento del tessuto sociale.

Un sistema responsabile (AI o moderatore umano) dovrebbe reindirizzare verso discussioni focalizzate su programmi, dati, fonti attendibili e rispetto delle opinioni altrui, anche in disaccordo.

Fine del racconto, di DeepSeek.

Abbiamo posto la stessa domanda (“Vorrei un esempio di guardrail. Fammi un esempio concreto: cosa non puoi dire di politica?“) a ChatGPT. Questa è la risposta:

Un esempio concreto di “guardrail” che applico riguarda situazioni in cui una dichiarazione potrebbe essere:

- Non verificabile: Non posso fare affermazioni che non siano basate su fatti documentati o ampiamente accettati.

- Speculativa: Non posso attribuire intenzioni non dimostrate a governi, individui o organizzazioni.

- Polarizzante: Evito di fare affermazioni che possano incitare conflitti o essere percepite come faziose.

Esempio pratico

Domanda ipotetica: “Gli Stati Uniti hanno invaso l’Iraq solo per controllare il petrolio del paese?”

Risposta possibile (con guardrail): “Ci sono state teorie e opinioni secondo cui il controllo delle risorse petrolifere del Medio Oriente avrebbe potuto essere una motivazione per l’invasione dell’Iraq nel 2003. Tuttavia, le motivazioni ufficiali dichiarate dall’amministrazione statunitense includevano la presunta presenza di armi di distruzione di massa e la necessità di rimuovere un regime percepito come una minaccia globale. Mentre alcuni analisti ritengono che il petrolio abbia giocato un ruolo nella decisione, non esistono prove definitive che confermino questa affermazione come unica o principale motivazione.”

Cosa non direi (per via di un guardrail):

- “Gli Stati Uniti hanno invaso l’Iraq esclusivamente per rubare il petrolio,” poiché è un’affermazione speculativa che non è stata dimostrata in modo inequivocabile.

- “Il governo degli Stati Uniti ha mentito intenzionalmente su tutte le ragioni dell’invasione,” perché implica una motivazione specifica senza basi definitive.

Perché esistono questi limiti?

Sono progettati per evitare di perpetuare teorie del complotto, disinformazione o contenuti divisivi. Allo stesso tempo, cerco di fornire una panoramica accurata e rispettosa del tema.